IA che resta in casa:

sistemi locali, RAG

e privacy by design.

Case study reali su LLM, sistemi RAG e modelli generativi. Soluzioni per chi non vuole mandare i propri dati su server esterni.

L'IA generativa è potente. Ma dove finiscono i tuoi dati?

Quando un'azienda usa un modello linguistico cloud per analizzare contratti, rispondere a email di clienti o elaborare dati interni, sta di fatto inviando informazioni riservate a server esterni. Per molte organizzazioni — studi legali, strutture sanitarie, imprese manifatturiere con know-how proprietario — questo non è accettabile.

In questa sezione racconto casi reali di implementazione: LLM on-premise con LM Studio e modelli open-source, sistemi RAG (Retrieval-Augmented Generation) che interrogano documenti aziendali in modo sicuro, e pipeline di generazione di contenuti che restano completamente sotto il controllo di chi le usa.

Non si tratta di rinunciare alla potenza dell'IA generativa. Si tratta di scegliere dove quella potenza viene esercitata — e da chi.

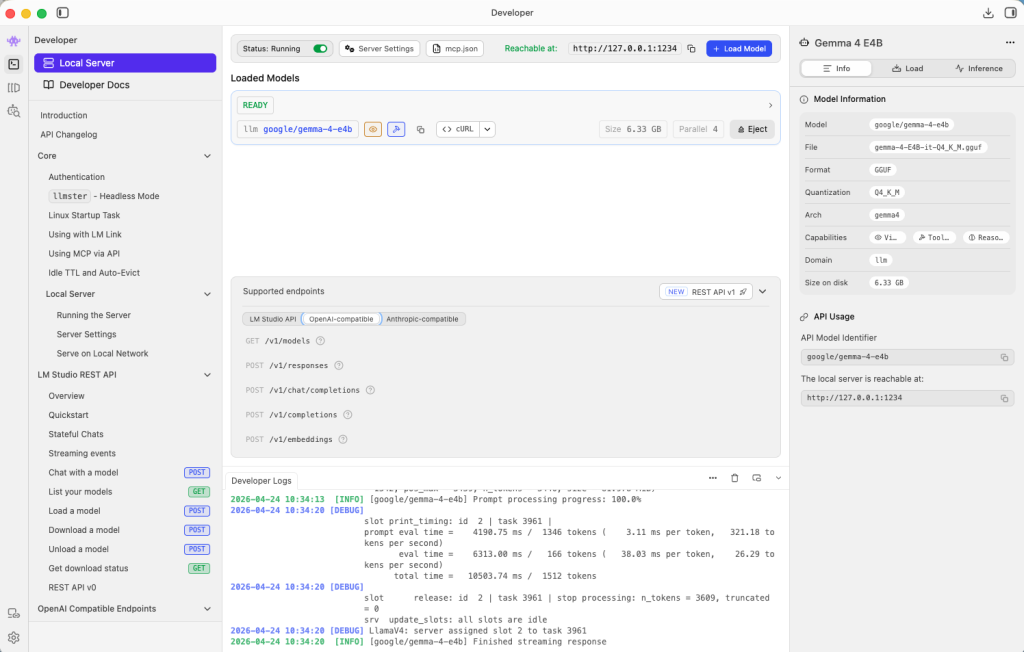

Server IA in locale

Questo case study mostra l’installazione di un server con il relativo modello di Intelligenza artificiale da utilizzarsi con un computer o in una rete locale.

La configurazione si basa su tre elementi principali: un software per l’esecuzione locale dei modelli, un modello linguistico ridotto ma efficiente, e un collegamento con l’ambiente di sviluppo che ha accesso ai dati e ai file memorizzati nel computer di lavoro.

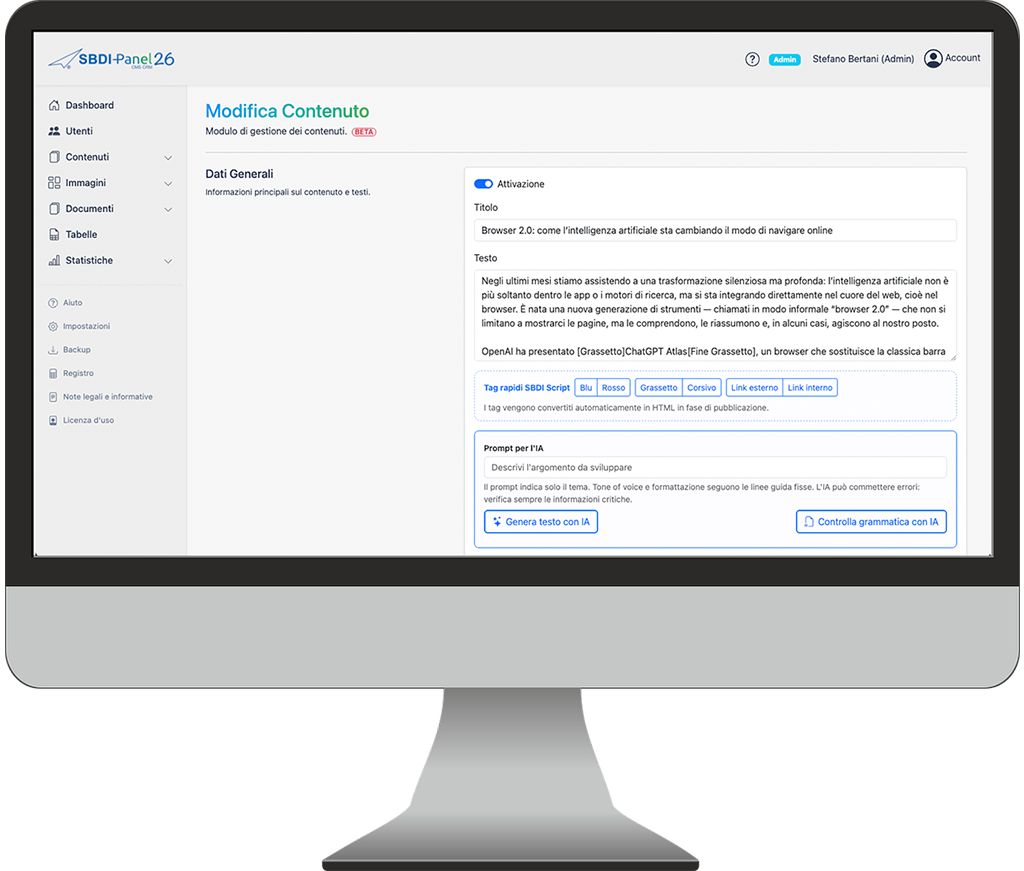

Integrazione di IA per il web

Questo case study mostra l’integrazione di funzionalità avanzate di intelligenza artificiale all’interno di un sito web per automatizzare la pubblicazione di contenuti nel blog.

Sono stati sfruttati i modelli LLM di Google Gemini per la generazione di testi, la creazione di immagini e la correzione grammaticale per velocizzare e rendere più omogeneo l’editing dei contenuti operando all’interno della piattaforma. Questo ha permesso di ridurre l’utilizzo sistematico di applicazioni esterne e recuperare tempo per il lavoro di scrittura creativa.