Abbiamo configurato un ambiente di intelligenza artificiale locale basato su un software capace di avviare modelli leggeri ma efficaci, e il risultato è stato sorprendente: un assistente IA che gira sul mio computer, che dialoga con l’ambiente di sviluppo ed è capace di supportare le mie attività senza inviare informazioni verso servizi esterni.

Per chi lavora con codice, documenti, progetti riservati o semplicemente vuole capire meglio cosa succede sotto il cofano, è un’esperienza davvero interessante.

La configurazione si basa su tre elementi principali: un software per l’esecuzione locale dei modelli, un modello linguistico e un collegamento con l’ambiente di sviluppo che ha accesso ai dati e ai file memorizzati nel computer.

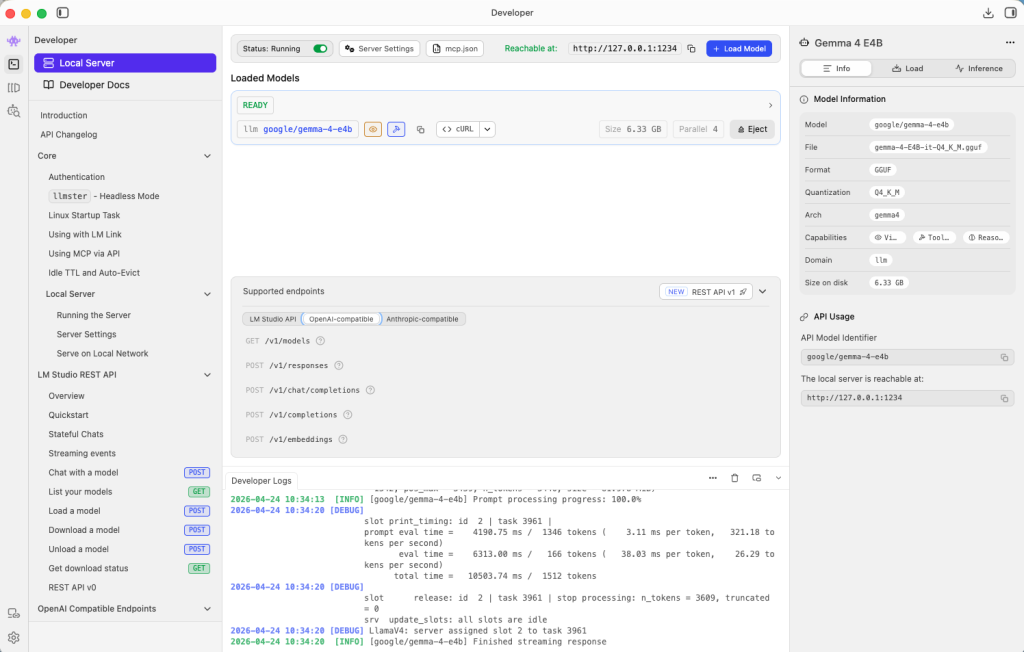

Il primo elemento è il software che permette di scaricare, avviare e gestire modelli di intelligenza artificiale direttamente in locale. In pratica diventa il motore operativo del sistema: si occupa dell’inferenza, cioè della generazione delle risposte, e può anche offrire una prima gestione della memoria di chat, utile per mantenere il filo della conversazione durante la sessione di lavoro.

Il secondo elemento è il modello linguistico, cioè il componente che elabora effettivamente le richieste. La scelta del modello è importante perché incide sulla qualità delle risposte, sulla velocità e sul consumo di memoria locale.

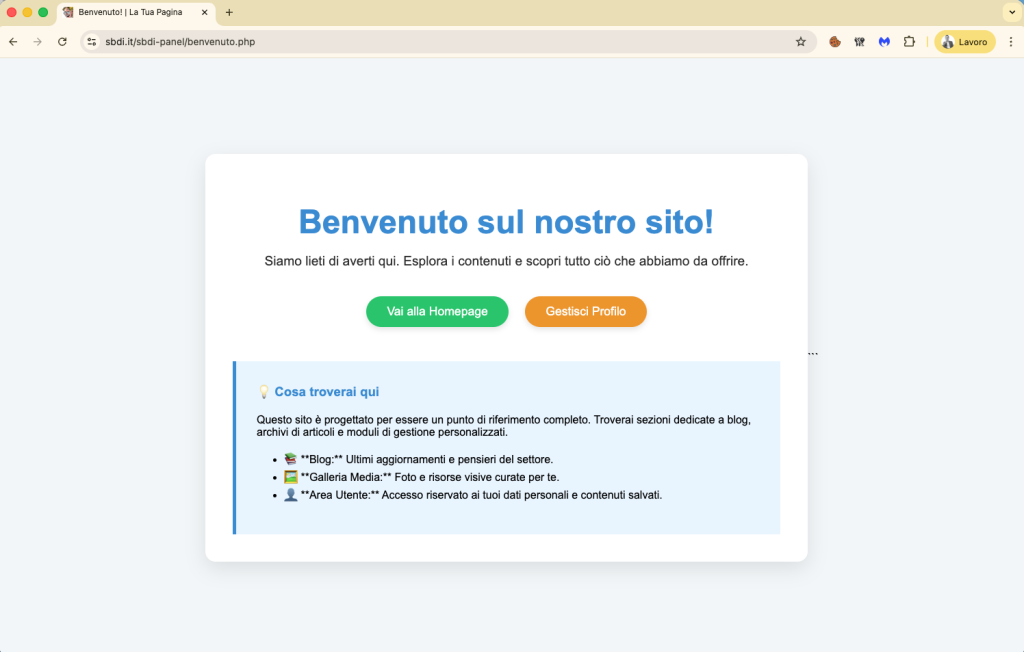

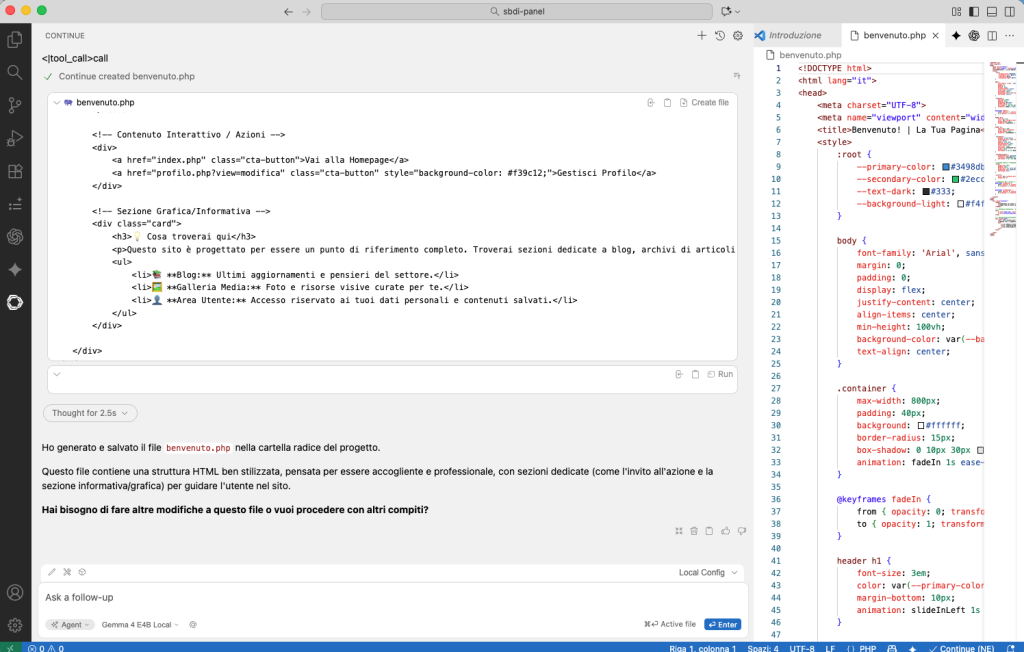

Il terzo elemento è l’integrazione con l’editor di codice. Questa parte consente di usare l’assistente IA direttamente sui file del computer, senza dover copiare e incollare continuamente codice da una finestra all’altra.

Semplificando molto, il flusso funziona così: l’editor raccoglie il contesto del lavoro, il connettore invia la richiesta al motore locale, il modello elabora la risposta e il risultato torna dentro l’ambiente di sviluppo.

Tutto avviene in locale ed è proprio questo che l’esperienza diventa importante. Come sempre, il controllo umano resta fondamentale però il salto operativo si sente. Non si sta più interrogando un servizio remoto ma si sta iniziando a costruire una piccola infrastruttura personale di lavoro aumentato, dove il modello è eseguito localmente e può essere collegato agli strumenti quotidiani.

Ma attenzione, tutto questo non significa avere già una piattaforma di Intelligenza artificiale aziendale completa.

Il software locale può eseguire il modello, gestire una chat interna e conservare una memoria della conversazione, ma se vogliamo costruire un’interfaccia web condivisa, accessibile da più persone, con profili utente, separazione dei progetti, archivio documentale RAG e memoria persistente, allora serve uno strato applicativo ulteriore.

In altre parole, il motore locale può essere il cuore del sistema, ma l’ecosistema va progettato a parte. Se un domani volessi creare una web app aziendale collegata al modello, dovrei decidere anche banalmente come vettorializzare eventuali documenti che compongono una knowledge base e come recuperare le informazioni rilevanti da fornire al modello.

Questo però è il punto in cui l’esperimento tecnico diventa progetto.

Per esempio, il primo tema è la base dati condivisa. Un assistente IA diventa davvero utile quando può lavorare su una memoria organizzata. Questo significa poter mettere a disposizione documenti di progetto, specifiche, file tecnici, appunti, decisioni già prese e convenzioni interne.

Il secondo tema è il recupero intelligente delle informazioni. In termini tecnici si parla spesso di RAG, cioè Retrieval Augmented Generation, ma il concetto si può spiegare in modo semplice: prima di rispondere, il sistema cerca nei documenti disponibili le informazioni più pertinenti e le passa al modello come contesto. In questo modo l’IA non si limita a produrre una risposta plausibile, ma lavora come prima accennato su una base di conoscenza definita.

Il terzo tema è la memoria. Una chat utile non dovrebbe dimenticare tutto alla chiusura della finestra. In un contesto professionale può essere importante distinguere tra memoria di breve periodo, legata alla conversazione in corso, e memoria di lungo periodo, legata al progetto, alle scelte tecniche e alle preferenze operative.

Ed è qui che la faccenda diventa ancora più interessante perché si tratta di progettare il modo in cui l’IA viene inserita nel flusso di lavoro.